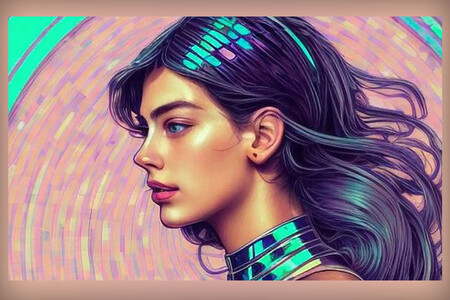

Durante los últimos días las redes sociales se han llenado con imágenes que retratan a las personas como personajes de fantasía en diferentes estilos artísticos. La aplicación detrás de la popularidad de estos retratos se llama Lensa, en la cual además de retocar fotos, los usuarios pueden hacer uso de una herramienta paga que les permite subir entre 10 y 12 selfies con las cuales la inteligencia artificial usada por Lensa los convierte en personajes sacados de una novela gráfica o retratados por un artista digital.

A pesar de la popularidad que ha ganado últimamente, los retratos que produce la aplicación han generado una serie de controversias que se enfocan en la política de privacidad que los usuarios deben aceptar para usar esta herramienta y los problemas éticos frente a la inteligencia artificial y su relación con artistas digitales.

Mientras que unos identificaron el propósito de Lensa como una forma de “acercar el arte a las masas”, el director de Prisma Labs, la compañía bajo la cual opera Lensa, Andrey Usoltsev afirmó a NBC News que “a medida que la tecnología de inteligencia artificial (IA) se vuelva cada vez más sofisticada y accesible, es probable que veamos que las herramientas y funciones impulsadas por IA se integren ampliamente en las aplicaciones orientadas al consumidor a una escala rápida. Nos gustaría ser parte de esta conversación en curso y dirigir el uso de dicha tecnología de una manera segura y ética”.

Lensa utiliza el modelo de inteligencia artificial llamado Difusión Estable, el cual es de open source y gratuito, para generar sus imágenes. Este modelo genera imágenes a partir de una frase. “Una de las principales quejas de los artistas es que la función “Magic Avatar” utiliza el modelo de fuente abierta de Stable Diffusion para imágenes generativas, que se entrena en un enorme conjunto de datos de red abierta de inteligencia artificial a gran escala (LAION), LAION-5B, que contiene URL a miles de millones de imágenes en la web junto con etiquetas descriptivas. Los conjuntos de datos de LAION han sido criticados anteriormente por alojar imágenes que revelan información médica privada y por extraer imágenes con derechos de autor de millones de artistas que publican su trabajo en sitios de alojamiento como DeviantArt, Pinterest y ArtStation”, escribió Rhea Nayyar para Hyperallergic.

De acuerdo con lo que escribió Nayyar, uno de los problemas que levanta esta nueva tendencia es el hecho de que la base de datos que nutre la inteligencia artificial utilizada se nutre de las obras hechas por artistas digitales y no les paga regalías por su uso o reconoce la autoría de estos artistas. “Con la asequibilidad de $8 dólares por un conjunto de 50 imágenes estilizadas, no es de extrañar que los artistas independientes estén preocupados por sus ingresos, además del hecho de que Lensa ya tomó sus obras de arte para entrenar su producción de IA con fines de lucro”.

No solo son los artistas los que han prendido las alarmas sobre esta aplicación y las imágenes que produce. Tanto usuarios como expertos advierten que hay riesgos al utilizar Lensa, pues en su política de privacidad, aunque estipulan que las fotos proporcionadas no serán almacenadas ni utilizadas para otros fines que no sean el entrenamiento de la propia inteligencia artificial, reclaman el derecho de utilizar las imágenes generadas por la inteligencia artificial de la forma que les plazca.

Los términos y condiciones presentados por la aplicación estipulan que el usuario que descargue Lensa y suba sus fotos a la plataforma otorga “licencia perpetua, irrevocable, no exclusiva, libre de regalías, mundial, totalmente pagada, transferible y sublicenciable para usar, reproducir, modificar, distribuir, crear trabajos derivados de su Contenido de usuario, sin ninguna compensación adicional para usted y siempre sujeto a su consentimiento explícito adicional para dicho uso cuando así lo exija la ley aplicable”.

Esto significa que, además de utilizar las fotografías proveídas para crear el producto final y entrenar al algoritmo, Lensa tiene el control total de las imágenes producidas para darles el uso que vean conveniente. Más allá de las preocupaciones frente a la privacidad que eso puede generar, muchos usuarios han denunciado la forma en que la aplicación cambia radicalmente su apariencia o añade características a las imágenes que produce.

Olivia Snow escibió en Wired que a pesar de que Lensa sugiere subir fotos en las que principalmente se vea el rostro del usuario y no subir fotos de menores de edad, la inteligencia artificial va más allá de crear solo retratos. “Los términos de servicio de Lensa instruyen a los usuarios a enviar solo contenido apropiado que contenga “no desnudos” y “no niños, solo adultos”. Y, sin embargo, muchos usuarios, principalmente mujeres, han notado que incluso cuando suben fotos modestas, la aplicación no solo genera desnudos, sino que también atribuye a sus imágenes características caricaturescas y sexualizadas, como poses sensuales y senos gigantes. Yo, por ejemplo, recibí varios resultados completamente desnudos a pesar de subir solo fotos de mi rostro”, describió en su texto.

La escritora cuenta que quiso probar la política que prohíbe subir fotos de menores de edad y cuando lo hizo se encontró con un resultado que la dejó horrorizada. “En algunos casos, la IA parecía reconocer mi cuerpo de niña y, afortunadamente, se olvidó de agregar senos. Probablemente, esto no fue un reflejo de la ética personal de la tecnología, sino de los patrones que identificó en mi foto; tal vez percibió mi pecho plano como el de un hombre adulto. En otras fotos, la IA adjuntó orbes a mi pecho que eran distintos de la ropa, pero también diferentes a las fotos de desnudos que habían producido mis otras pruebas”.

Aunque Usoltsev dijo a Techcrunch que “nuestros Términos de uso (Cláusula 6) y los Términos de servicio de Stability AI (Pautas rápidas) prohíben explícitamente el uso de la herramienta para participar en cualquier comportamiento dañino o de acoso. La forma en que se estructuró el experimento [de TechCrunch] señala que tales creaciones no pueden producirse accidentalmente. Las imágenes son el resultado de una mala conducta intencional en la aplicación” y que están trabajando para desarrollar un filtro contra imágenes sexuales, la controversia continúa.

NAM/

Síguenos en nuestras redes sociales para que tengas toda la ¡INFORMACIÓN AL INSTANTE!

Visita nuestro sitio web https://noticiaalminuto.com/

Twitter: https://bit.ly/3kpAtzz

Instagram: https://bit.ly/3jh0TnE

Telegram: https://bit.ly/3Dvclo3

Grupo de WhatsApp: https://chat.whatsapp.com/GlOEXjCuQ5I1uQbVzZig4m